Mạng Nơ-ron nhân tạo (Neural Networks): Tìm hiểu chi tiết

1. Giới thiệu

Mạng nơ-ron nhân tạo (Artificial Neural Networks – ANN) là một mô hình tính toán được lấy cảm hứng từ cấu trúc và chức năng của bộ não con người. ANN được thiết kế để thực hiện:

- Nhận diện các mẫu phức tạp.

- Thực hiện các nhiệm vụ như phân loại, dự đoán, và xử lý dữ liệu.

Lịch sử phát triển:

- Bắt đầu từ những năm 1940 với các nghiên cứu về mô hình neuron đơn giản.

- Trải qua nhiều giai đoạn cải tiến kiến trúc và thuật toán học.

- Đóng vai trò quan trọng trong sự phát triển của trí tuệ nhân tạo hiện đại.

ANN ảnh hưởng mạnh mẽ đến các lĩnh vực:

- Thị giác máy tính.

- Xử lý ngôn ngữ tự nhiên.

- Y học và nhiều ứng dụng công nghệ khác.

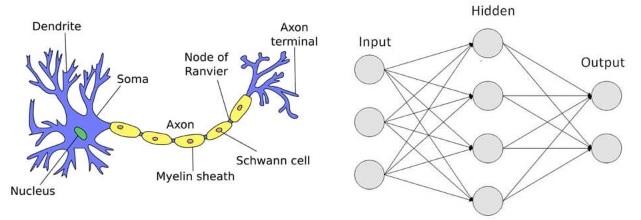

2. Cấu trúc của mạng nơ-ron nhân tạo

Mạng nơ-ron nhân tạo gồm các đơn vị nhỏ gọi là nơ-ron, mỗi nơ-ron như một hàm tính toán. Mạng thường có ba lớp chính:

Lớp đầu vào (Input Layer)

- Nhận thông tin từ bên ngoài vào mạng.

- Số lượng nơ-ron phụ thuộc vào số đặc trưng (features) của dữ liệu.

Lớp ẩn (Hidden Layer)

- Thực hiện các tính toán phức tạp để tìm đặc trưng ẩn trong dữ liệu.

- Có thể có nhiều lớp ẩn khác nhau.

Lớp đầu ra (Output Layer)

- Đưa ra kết quả của mạng.

- Số lượng nơ-ron phụ thuộc vào bài toán:

– Phân loại nhị phân: 1 nơ-ron.

– Phân loại đa lớp: Số nơ-ron tương ứng với số lớp.

3. Nguyên lý hoạt động

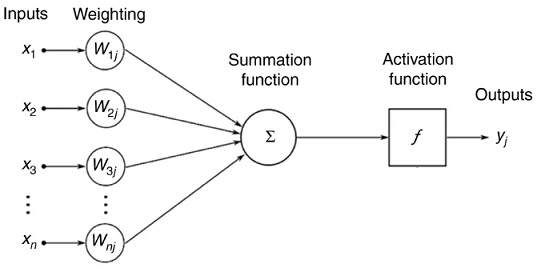

3.1. Công thức tính toán trong nơ-ron

Mỗi nơ-ron nhận đầu vào, tính toán đầu ra dựa trên:

$$ y = f\left(\sum_{i=1}^{n} w_i x_i + b\right) $$

- \( x_i \): Giá trị đầu vào.

- \( w_i \): Trọng số của kết nối.

- \( b \): Giá trị thiên lệch.

- \( f \): Hàm kích hoạt.

- \( y \): Đầu ra của nơ-ron.

Sau khi tính tổng đầu vào $$ z $$ nơ-ron áp dụng hàm kích hoạt để tạo đầu ra, giúp mô hình hóa quan hệ phi tuyến.

3.2. Hàm kích hoạt

Hàm Sigmoid

- Chuyển đổi giá trị đầu vào thành giá trị từ 0 đến 1.

- Phù hợp cho bài toán phân loại.

- Công thức: $$ f(x) = \frac{1}{1 + e^{-x}} $$

Hàm ReLU

- Giúp mạng học nhanh hơn, đặc biệt trong mô hình lớn.

- Công thức: $$ f(x) = \max(0, x) $$

Hàm Tanh

- Tương tự Sigmoid, nhưng đầu ra từ -1 đến 1.

- Hữu ích cho bài toán liên quan giá trị âm.

- Công thức: $$ f(x) = \frac{2}{1 + e^{-2x}} – 1 $$

3.3. Quá trình lan truyền tiến (Feedforward)

- Dữ liệu đầu vào truyền từ lớp đầu vào qua lớp ẩn đến lớp đầu ra.

- Mỗi nơ-ron tính toán đầu ra và truyền tiếp.

Ví dụ với mạng đơn giản (một lớp đầu vào, một lớp ẩn, một lớp đầu ra):

Đầu vào:

- \( x_1 \), \( x_2 \): Các giá trị đầu vào từ lớp đầu vào.

Các trọng số kết nối giữa lớp đầu vào và lớp ẩn:

- \( w_{11} \), \( w_{12} \): Trọng số từ \( x_1 \), \( x_2 \) đến nơ-ron đầu tiên trong lớp ẩn.

- \( w_{21} \), \( w_{22} \): Trọng số từ \( x_1 \), \( x_2 \) đến nơ-ron thứ hai trong lớp ẩn.

$$ z_1 = w_{11}x_1 + w_{12}x_2 + b_1 $$

$$ z_2 = w_{21}x_1 + w_{22}x_2 + b_2 $$

- Đầu ra lớp ẩn: $$ a_1 = \sigma(z_1) $$ $$ a_2 = \sigma(z_2) $$ truyền đến lớp tiếp theo.

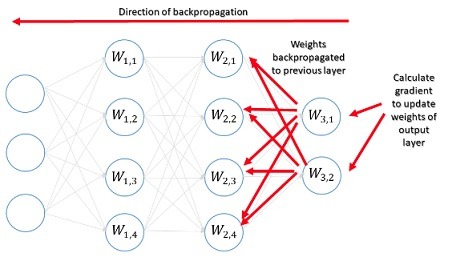

3.4. Quá trình lan truyền ngược (Backpropagation)

- Cập nhật trọng số dựa trên lỗi giữa đầu ra dự đoán và thực tế.

- Sử dụng hàm mất mát, ví dụ: Mean Squared Error (MSE).

$$ L = \frac{1}{2} \sum_{i=1}^{n} (y_i – \hat{y}_i)^2 $$

- \( y_i \): Giá trị thực tế của đầu ra.

- \( \hat{y}_i \): Giá trị dự đoán của mạng.

Cập nhật trọng số bằng gradient descent:

$$ w_i = w_i – \eta \frac{\partial L}{\partial w_i} $$

- \( \eta \): Tốc độ học (learning rate).

- \( \frac{\partial L}{\partial w_i} \): Đạo hàm của hàm mất mát đối với trọng số \( w_i \).

Ví dụ cụ thể:

- Mạng với một lớp đầu vào (2 nơ-ron), một lớp ẩn (2 nơ-ron), một lớp đầu ra (1 nơ-ron).

- Đầu ra thực tế: $$ y = 0.5 $$

- Đầu ra dự đoán: $$ \hat{y} = 0.6 $$

- Lỗi: $$ L = \frac{1}{2} (0.5 – 0.6)^2 = 0.005 $$

- Điều chỉnh trọng số để giảm lỗi trong các lần lặp tiếp theo.

4. Các loại mạng nơ-ron nhân tạo phổ biến

4.1. Feedforward Neural Network – FNN

- Dạng đơn giản nhất, tín hiệu di chuyển một chiều từ đầu vào đến đầu ra.

- Cấu trúc: Lớp đầu vào, lớp ẩn, lớp đầu ra.

$$ y = f(Wx + b) $$

- \( x \): Vector đầu vào.

- \( W \): Ma trận trọng số.

- \( b \): Hệ số dịch chuyển.

- \( f \): Hàm kích hoạt.

4.2. Convolutional Neural Network – CNN

- Dùng cho nhận diện hình ảnh, dựa trên phép tích chập.

- Giảm số lượng tham số so với FNN.

$$ (f * g)(i, j) = \sum_m \sum_n f(m, n) \cdot g(i – m, j – n) $$

- \( f(i, j) \): Giá trị điểm ảnh tại \( (i, j) \) của ảnh đầu vào.

- \( g(m, n) \): Giá trị tại \( (m, n) \) của kernel.

- \( (i, j) \): Tọa độ điểm ảnh trong kết quả tích chập.

4.3. Recurrent Neural Network – RNN

- Có kết nối vòng lặp, ghi nhớ ngữ cảnh trong chuỗi dữ liệu.

- Phù hợp với chuỗi thời gian, xử lý ngôn ngữ tự nhiên.

$$ h_t = f(W_h h_{t-1} + W_x x_t + b) $$

- \( h_t \): Trạng thái ẩn tại thời điểm \( t \).

- \( x_t \): Đầu vào tại thời điểm \( t \).

- \( W_h \), \( W_x \): Trọng số.

- \( b \): Hệ số dịch chuyển.

4.4. Long Short-Term Memory – LSTM

- Biến thể của RNN, giải quyết vấn đề “quên ngắn hạn”.

- Giữ thông tin lâu dài nhờ các cổng kiểm soát.

$$ i_t = \sigma(W_i \cdot [h_{t-1}, x_t] + b_i) $$

- \( \sigma \): Hàm sigmoid.

- \( W_i \): Trọng số cổng đầu vào.

- \( h_{t-1} \): Trạng thái ẩn tại \( t-1 \).

- \( x_t \): Đầu vào tại \( t \).

- \( b_i \): Hệ số dịch chuyển.

4.5. Generative Adversarial Network – GAN

- Gồm mạng sinh (Generator) và mạng phân biệt (Discriminator).

- Mạng sinh tạo dữ liệu giả, mạng phân biệt phân biệt dữ liệu thật/giả.

$$ \min_G \max_D V(D, G) = \mathbb{E}_{x \sim p_{data}(x)}[\log D(x)] + \mathbb{E}_{z \sim p_z(z)}[\log(1 – D(G(z)))] $$

- \( G \): Mạng sinh.

- \( D \): Mạng phân biệt.

- \( p_{data}(x) \): Phân phối dữ liệu thật.

- \( p_z(z) \): Phân phối ngẫu nhiên đầu vào.

5. Ứng dụng của mạng nơ-ron nhân tạo

5.1. Y tế

- Chẩn đoán hình ảnh y tế: Phân tích X-quang, MRI, CT scan để phát hiện ung thư, tổn thương não.

- Dự đoán kết quả điều trị: Phân tích bệnh án, dự đoán hiệu quả điều trị.

5.2. Tài chính

- Dự đoán giá cổ phiếu: Phân tích dữ liệu lịch sử, biến động thị trường.

- Phát hiện gian lận: Phân tích giao dịch, phát hiện bất thường.

- Quản lý rủi ro: Dự đoán rủi ro tín dụng, tối ưu danh mục đầu tư.

5.3. Vận tải

- Xe tự lái: Nhận diện giao thông, người đi bộ, biển báo.

- Tối ưu hóa lộ trình: Dựa trên dữ liệu giao thông, thời tiết, tai nạn.

- Quản lý đội xe: Dự đoán nhu cầu, tối ưu tài nguyên.

5.4. Giáo dục

- Học tập cá nhân hóa: Phân tích hành vi, đề xuất học tập phù hợp.

- Hệ thống giảng dạy thông minh: Đánh giá bài tập, phản hồi tức thời.

- Phát hiện gian lận thi cử: Phân tích hành vi bất thường.

5.5. Giải trí

- Hệ thống đề xuất: Phân tích sở thích, đề xuất nội dung (Netflix, YouTube, Spotify).

- Phát triển trò chơi điện tử: Tạo nhân vật AI thông minh, chân thực.

- Xử lý âm thanh, hình ảnh: Cải thiện chất lượng phim, âm nhạc, video.

6. Thách thức của mạng nơ-ron nhân tạo

- Đòi hỏi tài nguyên tính toán khổng lồ: Cần GPU/TPU, tiêu tốn năng lượng, thời gian.

- Vấn đề quá khớp (Overfitting): Mô hình học quá chi tiết, kém hiệu quả với dữ liệu mới.

- Tính minh bạch và giải thích: Mô hình như “hộp đen”, khó giải thích quyết định (vấn đề trong y tế, tài chính).

- Yêu cầu lượng dữ liệu lớn: Cần dữ liệu khổng lồ, thu thập và xử lý tốn kém.

7. Kết luận

- ANN đóng vai trò cốt lõi trong phát triển trí tuệ nhân tạo (AI).

- Mô phỏng não người, giải quyết bài toán phức tạp (nhận diện hình ảnh, ngôn ngữ, dự đoán kinh tế, y học).

- Thách thức: Nhu cầu tài nguyên, quá khớp, tính minh bạch.

- Tương lai: Sẽ mạnh mẽ hơn, mở rộng ứng dụng, nhưng cần xử lý đạo đức, bảo mật.